Sou daquela geração que virou fã de Fórmula 1 por causa do sucesso de Emerson Fittipaldi e ainda hoje assisto às corridas pela televisão. Com o passar do tempo, as transmissões se sofisticaram, toda hora aparece na tela algum ordenamento das posições. Ora é a ordem na corrida, ora é o ranking do tempo de parada dos carros nos boxes para troca de pneus; dando uma piscada de olho, aparece o ranking de volta mais rápida, ou então a mudança da tabela do campeonato de acordo com as posições momentâneas na corrida em andamento. Se não prestar atenção, quem passa pela sala pode achar que a troca de pneus mais rápida é o líder da corrida ou encabeça o campeonato. Acredito que nem todos sejam fãs de corridas de carros, mas futebol é uma paixão nacional, explícita ou envergonhada, e assim tento imaginar alguém acompanhando o Campeonato Brasileiro apenas conferindo a tabela de pontos, sem assistir aos debates (prometendo jamais voltar a assisti-los) ou aos jogos de vez em quando. A tabela ao final indica o campeão, os classificados para a Copa Libertadores e quais são os times rebaixados. E só prestando atenção à tabela os sábios dirão uma inutilidade aos torcedores desse ou daquele time: no ano que vem o “escrete” precisará ganhar mais e perder menos. Deixando de lado esportes específicos, voltemo-nos a uma apreciação multivariável, como os Jogos Pan-Americanos. Pelo ranking de medalhas da última edição em Lima, Peru, o nosso esporte melhorou da água para o vinho em poucos anos. Será mesmo? E, afinal, o objetivo de uma política de promoção do esporte é ganhar medalhas em competições internacionais? E não resisto aqui a lembrar de como variam as interpretações dos rankings esportivos. O Comitê Olímpico Internacional determina que o ordenamento seja por número de medalhas de ouro e em caso de empate, pela quantidade das de prata e depois pelas de bronze. Os EUA sempre obedeceram à regra, ciosos de sua liderança no espírito de “quem ganha prata, perde o ouro”, mas nas Olimpíadas de Beijing, os chineses passaram à frente e a imprensa estadunidense começou a apresentar o quadro de medalhas pela soma dos três tipos, que devolvia a liderança para a delegação dos Estados Unidos. Enfim, o esporte é cheio de listas que se confundem, que por si só não dizem nada e que podem ser manipuladas e reinterpretadas pela imprensa, shareholders e stakeholders (ah, como me aborrecem essas palavras). E não é que passou a ser assim também com os rankings de universidades?

Sou daquela geração que virou fã de Fórmula 1 por causa do sucesso de Emerson Fittipaldi e ainda hoje assisto às corridas pela televisão. Com o passar do tempo, as transmissões se sofisticaram, toda hora aparece na tela algum ordenamento das posições. Ora é a ordem na corrida, ora é o ranking do tempo de parada dos carros nos boxes para troca de pneus; dando uma piscada de olho, aparece o ranking de volta mais rápida, ou então a mudança da tabela do campeonato de acordo com as posições momentâneas na corrida em andamento. Se não prestar atenção, quem passa pela sala pode achar que a troca de pneus mais rápida é o líder da corrida ou encabeça o campeonato. Acredito que nem todos sejam fãs de corridas de carros, mas futebol é uma paixão nacional, explícita ou envergonhada, e assim tento imaginar alguém acompanhando o Campeonato Brasileiro apenas conferindo a tabela de pontos, sem assistir aos debates (prometendo jamais voltar a assisti-los) ou aos jogos de vez em quando. A tabela ao final indica o campeão, os classificados para a Copa Libertadores e quais são os times rebaixados. E só prestando atenção à tabela os sábios dirão uma inutilidade aos torcedores desse ou daquele time: no ano que vem o “escrete” precisará ganhar mais e perder menos. Deixando de lado esportes específicos, voltemo-nos a uma apreciação multivariável, como os Jogos Pan-Americanos. Pelo ranking de medalhas da última edição em Lima, Peru, o nosso esporte melhorou da água para o vinho em poucos anos. Será mesmo? E, afinal, o objetivo de uma política de promoção do esporte é ganhar medalhas em competições internacionais? E não resisto aqui a lembrar de como variam as interpretações dos rankings esportivos. O Comitê Olímpico Internacional determina que o ordenamento seja por número de medalhas de ouro e em caso de empate, pela quantidade das de prata e depois pelas de bronze. Os EUA sempre obedeceram à regra, ciosos de sua liderança no espírito de “quem ganha prata, perde o ouro”, mas nas Olimpíadas de Beijing, os chineses passaram à frente e a imprensa estadunidense começou a apresentar o quadro de medalhas pela soma dos três tipos, que devolvia a liderança para a delegação dos Estados Unidos. Enfim, o esporte é cheio de listas que se confundem, que por si só não dizem nada e que podem ser manipuladas e reinterpretadas pela imprensa, shareholders e stakeholders (ah, como me aborrecem essas palavras). E não é que passou a ser assim também com os rankings de universidades?

O penúltimo ranking 2019 a aparecer na praça foi o de Leiden, que chamou a atenção pela manchete “Ranking de produção científica classifica a USP como a 8ª melhor do mundo”. O ranking em questão é o CWTS (Centro de Estudos em Ciência e Tecnologia) da Universidade de Leiden, Holanda, referência mundial em cientometria, isto é, estudo de indicadores de produção científica. Mas a manchete está equivocada. Antes de mais nada, é preciso deixar claro que a USP é uma das maiores (e melhores) universidades do mundo e o ranking de Leiden é, talvez, o único ranking de fato útil que existe no mercado, mas é necessário desenvolver a questão. Vamos, então aos dados.

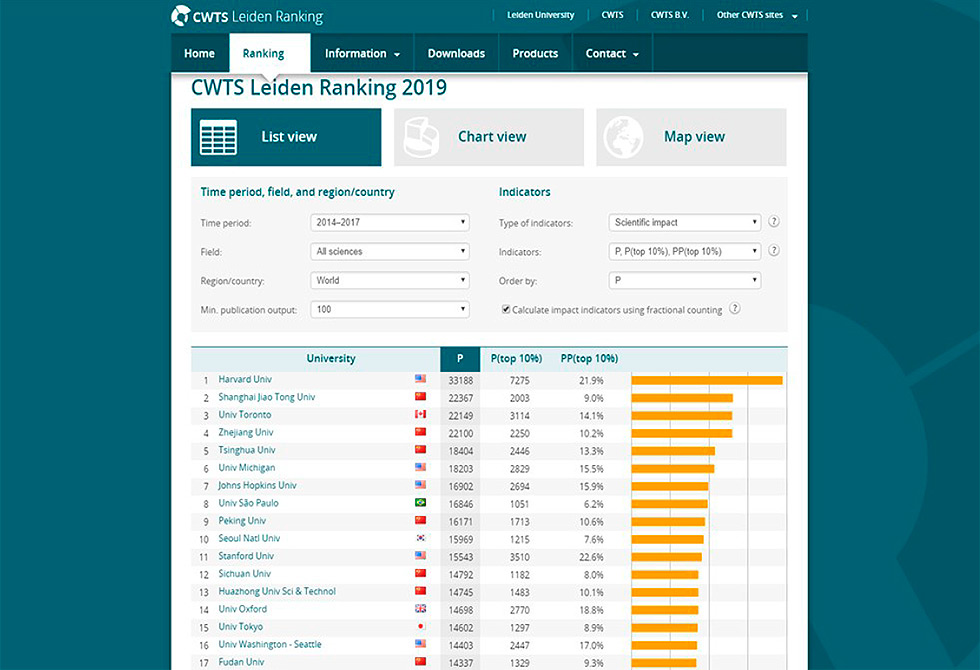

Ao acessar o tal ranking, o internauta depara-se com a imagem da figura abaixo, que apresenta janelas de opções, mas a lista padrão (um ranking) é de volume de produção científica (número de artigos publicados por cada universidade), ou seja, quantidade e não, digamos, qualidade, que stake e shareholders sinonimizaram por impacto das publicações (número de citações desses artigos). Para ter um dos ordenamentos possíveis os jornalistas precisam clicar ao lado no P (top 10%) ou PP (top 10%), número de artigos entre os 10% mais citados e a porcentagem desses em relação ao total, respectivamente. Mas vejam que existem várias seleções possíveis: período temporal das publicações, área do conhecimento, região geográfica, corte por número de publicações, tipo de indicador (impacto, colaboração, acesso aberto e gênero) e os respectivos indicadores. E, por fim, o tipo de ordenamento (vulgo ranking). São um total de 1944 rankings possíveis (sem contar os recortes geográficos), escolha o seu. Eu deixo os rankings de lado e vou às outras duas opções gerais possíveis ao lado da “listview”: gráficos e mapas.

Primeiro, no entanto, é preciso saber do que se trata o ranking: exclusivamente de pesquisa na forma de artigos publicados na base Web of Science, como informado no portal do CWTS. É, portanto, apenas um recorte (ainda que importante e internacional) de uma das missões de uma universidade. E o que é uma universidade? A posição dos responsáveis pelo ranking é claramente informada [I]: “identificar universidades é um desafio devido à falta de critérios internacionalmente aceitos que definam universidades. Tipicamente, uma universidade é caracterizada por uma combinação de atividades de educação e pesquisa em conjunto com uma autoridade de conferir doutorados [II]. No entanto, essas características não significam que universidades sejam entidades homogêneas, que permitam comparações internacionais em cada um dos aspectos”. Esse é um problema crucial dos rankings e o grupo de Leiden sugere ater-se a um possível ponto em comum: universidades com atividades intensas de pesquisa. Mesmo assim ainda advertem: “No entanto, a pontuação dos rankings para cada instituição deve ser avaliada no contexto de sua missão e responsabilidades próprias, que estão fortemente ligadas aos sistemas acadêmicos nacionais e regionais”. Essas diferenças se refletem nos resultados do ranking de Leiden, bem como as mudanças com o passar do tempo. Então, em vez de listar simplesmente, poderíamos usar o repositório de dados disponíveis para entender melhor tendências, missões e papeis de universidades, pelo que os dados recortados de pesquisa revelam ou não dão conta. E isso, que é importante e raramente feito, só é possível, com todas as suas limitações com o ranking do CWTS, os outros são apenas listas com indicadores pouco confiáveis embrulhados em caixas pretas.

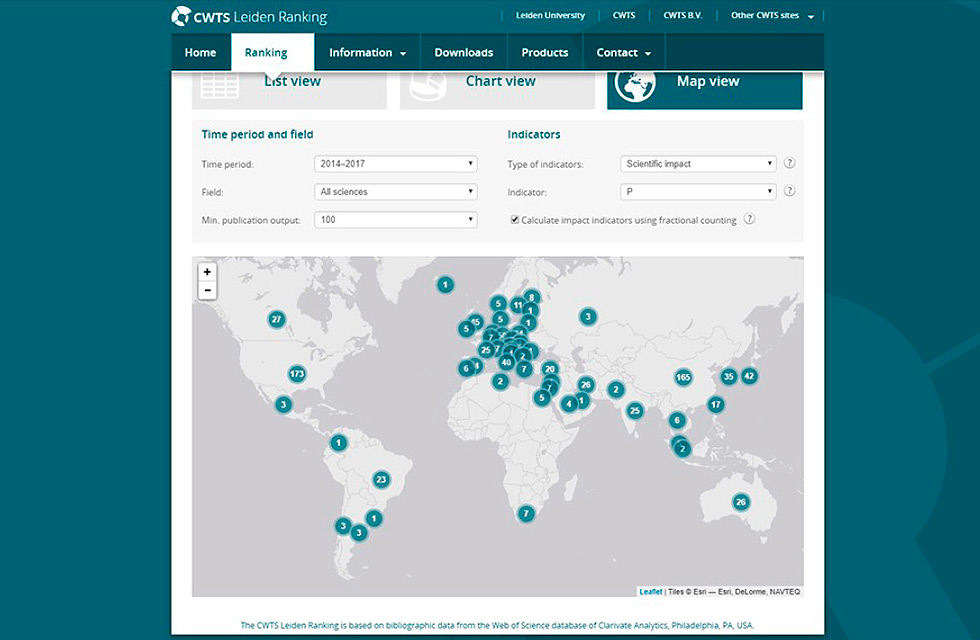

Em resumo, a lista contém 963 universidades que tenham publicado pelo menos 1.000 artigos, somando as diferentes áreas do conhecimento no período 2014-2017 (edição 2019). É o critério de corte para a ideia de universidade de pesquisa [III]. São ao todo 963 universidades de um total estimado de 18 mil instituições do tipo[iv], ou seja, o ranking se limita a um conjunto que corresponde a apenas 5% do total, e que é considerado como de atividade intensa em pesquisa. Como essas instituições estão distribuídas pelo mundo? Não é necessário percorrer a listagem, podemos clicar no mapa, que também ilustra (abaixo) esta coluna.

Além do óbvio domínio da América do Norte, Europa e Extremo Oriente, podemos olhar para duas outras regiões. A América do Sul contabiliza 31 universidades intensas em pesquisa, sendo 23 no Brasil, todas públicas. O triste contraste é a África com uma população de 1,2 bilhão de habitantes e apenas 14 universidades desse tipo, concentradas somente em 3 países em seus extremos norte e sul. O que isso pode dizer sobre desigualdades e outras questões sociais?

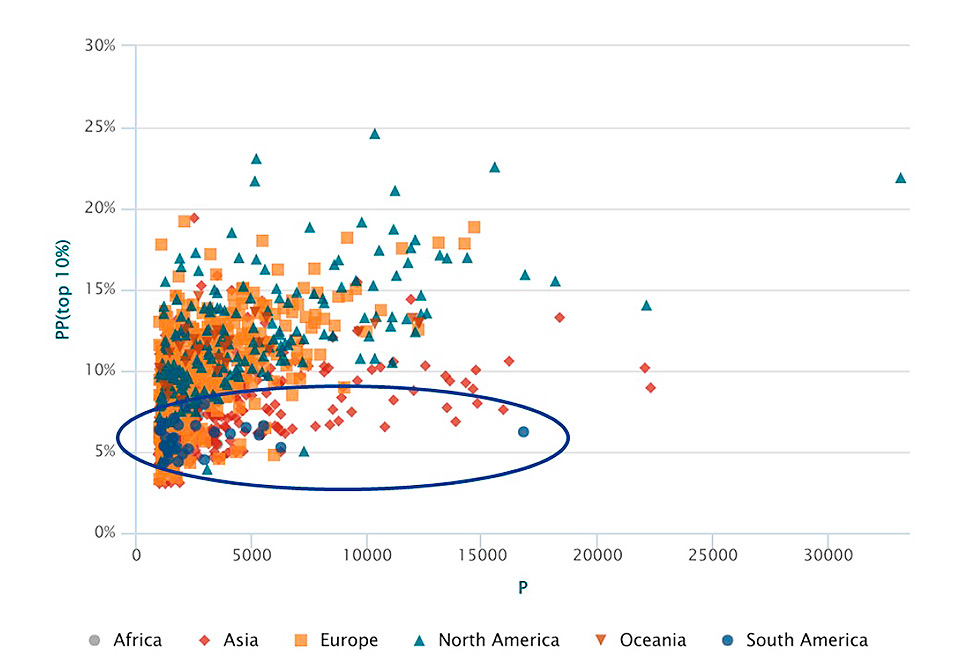

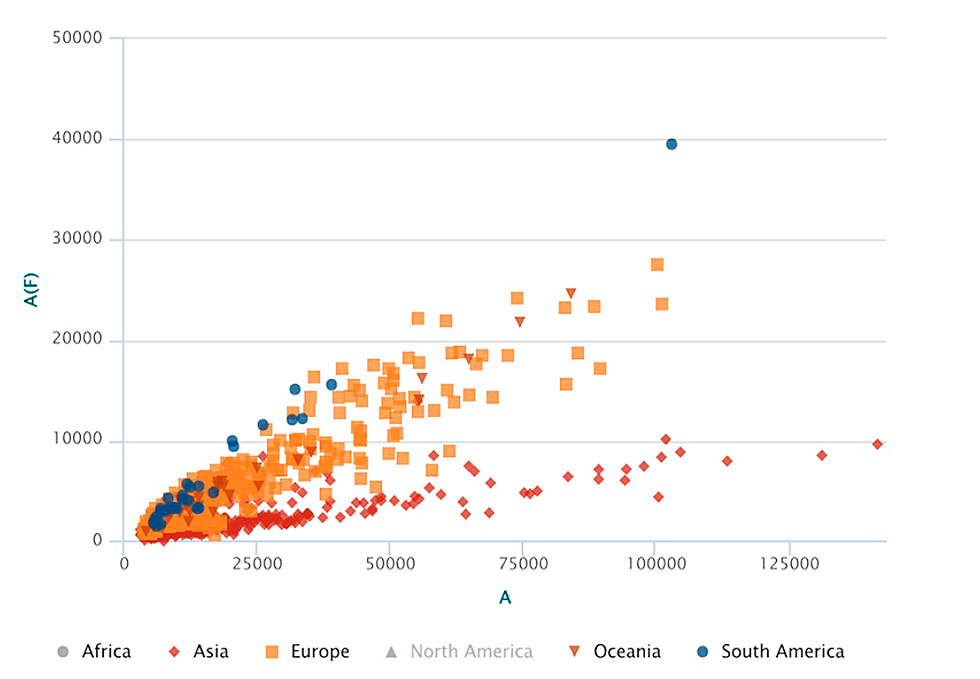

O mapa pode ter sua escala modificada para apreciar melhor as distribuições regionais, como, por exemplo, o peso da costa leste dos EUA. Pode-se, também, explorar aqui alguns dos 1944 ordenamentos possíveis, mas agora na forma de gráficos e não de listas. Os recursos diretamente acessíveis não são muitos, mas escolhi algo sobre impacto, colaboração e gênero, recortados da tela do computador. O primeiro gráfico é uma das versões sobre impacto das publicações científicas de cada universidade: a porcentagem dos artigos de cada universidade que aparecem entre os 10% mais citados do total de artigos da base Web of Science (levando em conta as diferenças entre as áreas do conhecimento), PP(10%), em função do total de artigos de cada universidade. Existem ainda disponíveis versões para 1%, 5% e 50%, com a mesma interpretação. Observa-se que apenas seis universidades norte-americanas têm entre 20% e 25% de seus artigos publicados entre 2014 e 2017 na faixa top 10%. Observa-se que cerca de 40 estão na faixa entre 15% e 20% de seus artigos entre os “top 10%”. As outras 900 e tantas se concentram abaixo, com as sul-americanas (na região circulada) emparelhadas com várias norte-americanas, europeias e asiáticas. O triângulo azul bem à direita representa Harvard.

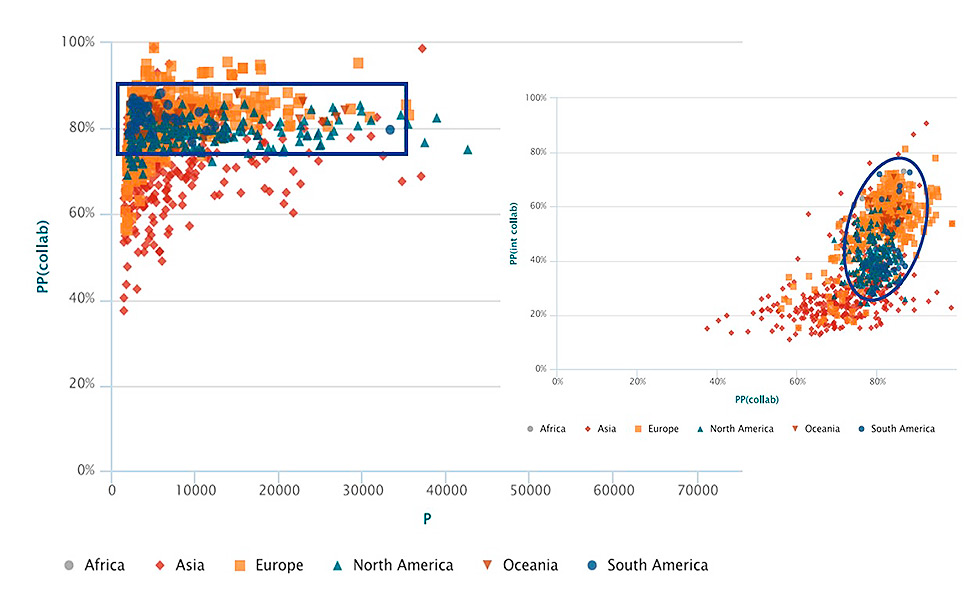

A seguir, pode-se olhar para indicadores de colaboração. O gráfico à esquerda representa a porcentagem dos artigos em colaboração em função do total de artigos de cada universidade. As sul-americanas estão na faixa indicada pelo retângulo, ou seja, apresentam alto índice de colaboração. As que menos colaboram, em geral (há exceções, camufladas pela quantidade de dados), são as asiáticas. No gráfico à direita temos a relação entre a porcentagem de colaboração internacional (eixo vertical) em função da porcentagem total de colaborações. Novamente a região do gráfico ocupado pelas universidades sul-americanas abrange uma ampla variação: respostas diferentes ao contexto de cada universidade. É interessante notar (novamente o contexto regional), que as universidades européias apresentam, em geral, uma internacionalização maior do que as norte-americanas.

Por fim uma rápida incursão nas questões de gênero no último gráfico, que representa o número de autorias femininas em função do número total de autorias de cada universidade. Quanto maior a universidade, maior é o número de artigos e, portanto, aumenta o número de autores, ou seja, autorias. Com o aumento do número de autores, certamente aumenta o número de autores femininos, mas a pergunta é: a que taxa? Cada universidade é um caso particular, mas haveria um comportamento geral em função da região? Observa-se que as sul-americanas apresentam a menor desigualdade de gênero, sendo suplantadas apenas por algumas universidades europeias, enquanto que as asiáticas são as que apresentam a maior desigualdade (excluímos as norte-americanas qie apresentam um comportamento intermediário, mas foram excluídas do gráfico, pois os números de Harvard – 237 mil autorias – deixariam o resto muito comprimido, dificultando a observação desse comportamento).

O site do ranking não permite fazer gráficos para verificar correlações entre, por exemplo, indicadores de impacto e de colaboração, ou entre impacto e colaboração e gênero, mas isso não representa um problema, apenas mais trabalho. O ranking de Leiden, ao contrário de seus colegas, disponibiliza todos os dados para serem descarregados: uma planilha Excel de 111 megabytes com todos os dados, incluindo indicadores que não são listados a partir de um ou dois cliques, como a média ponderada de citações por artigo desenvolvido pelo CWTS. Os dados podem ser usados livremente para pesquisas e análises, basta citá-los pelo DOI (digital object identifier) fornecido no sítio.

Com todas as limitações derivadas desse tipo de registro, esse ranking não é uma caixa-preta e fornece dados que podem ser usados para conhecer as universidades e suas diferenças no âmbito desse recorte sobre a pesquisa. Infelizmente, isso não é notícia na imprensa, mas afinal os stake&shakeholders também só pensam nas tais listas ordenadas. Uma preguiça, uma pena e um risco, quando não um perigo. No entanto, não quero finalizar com mau humor. Fiz um exercício com os rankings, afinal estão lá também: vasculhei os indicadores e consegui colocar cada uma das 23 universidades brasileiras como a “melhor” do país em algum deles. E dois resultados eu achei relevantes. Sabe qual é a segunda melhor universidade do mundo em igualdade de gênero? A Universidade Estadual de Maringá. Em proporção de artigos com acesso aberto, a melhor do Brasil é a Universidade Federal de São Paulo, mas em termos mundiais ela é apenas a 364ª com 45,5% de seus artigos em alguma modalidade de acesso aberto. Já o MIT libera o acesso a 69,5% de sua produção. Aí temos um interessante, mas longo, caminho a percorrer. Fica a dica de meta via os rankings.

[I] Seria interessante que os jornalistas e demais interessados clicassem um pouco mais para se informar melhor.

[II] Ou seja, estão considerando universidades de pesquisa.

[III] Esse número leva em conta a ponderação no computo de autoria que leva em conta a colaboração com outras universidades.

[IV] Tento aqui desenvolver argumentos anteriores, a estimativa aparece em referência em coluna anterior: https://www.unicamp.br/unicamp/ju/artigos/peter-schulz/balburdia-dos-rankings-e-o-ranking-das-balburdias