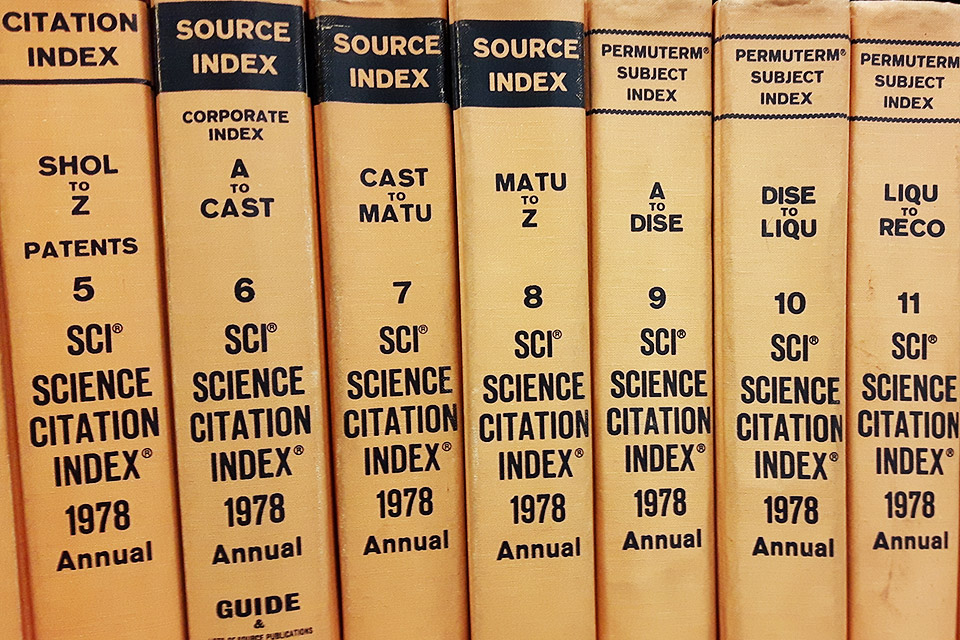

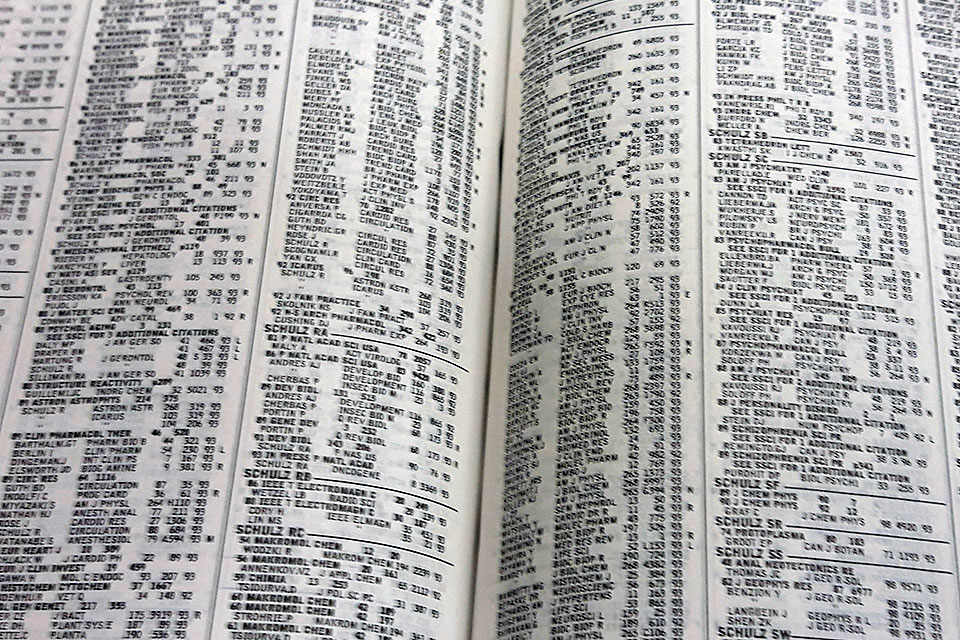

No início dos anos 1990 e da minha carreira docente, costumava ir à biblioteca do Instituto de Física da Unicamp todos os dias, por necessidade ou por ritual. Na sala de referências encontravam-se as revistas mais recentes, que chegavam, quando tínhamos sorte, com apenas alguns meses de atraso em relação às bibliotecas no Hemisfério Norte. Na mesma sala eram guardadas (ainda são) as edições anuais do Science Citation Index do Institute for Scientific Information, ISI: uma base de dados bibliográficos em milhares de folhas de papel com letras minúsculas. A “enciclopédia” anual de dados tinha três partes: volumes com as citações do ano dadas aos diferentes autores, outros com os artigos publicados de cada autor daquele ano e um conjunto de volumes que permitiam permutações de palavras-chave e autores.

No início dos anos 1990 e da minha carreira docente, costumava ir à biblioteca do Instituto de Física da Unicamp todos os dias, por necessidade ou por ritual. Na sala de referências encontravam-se as revistas mais recentes, que chegavam, quando tínhamos sorte, com apenas alguns meses de atraso em relação às bibliotecas no Hemisfério Norte. Na mesma sala eram guardadas (ainda são) as edições anuais do Science Citation Index do Institute for Scientific Information, ISI: uma base de dados bibliográficos em milhares de folhas de papel com letras minúsculas. A “enciclopédia” anual de dados tinha três partes: volumes com as citações do ano dadas aos diferentes autores, outros com os artigos publicados de cada autor daquele ano e um conjunto de volumes que permitiam permutações de palavras-chave e autores.

Na mesma época já se afirmara um campo científico baseado nesses dados: a bibliometria. Para nós, amadores no ramo, mesmo que cientistas em outras áreas, as buscas eram pequenas aventuras tediosas, que lembravam o fazer do escriturário de José Saramago no romance “Todos os Nomes”. Encontrar algo nesses calhamaços poderia ser facilitado se tivéssemos a oportunidade de assistir a um filme tutorial, gravado pelo próprio Eugene Garfield, criador do ISI, hoje curiosidade histórica que o pode ser vista no YouTube [I].

No final dessa década, os calhamaços reduziram-se a CD-Roms e buscas mais ágeis e frequentes, ainda que desajeitadas, surgiam nas telas dos microcomputadores, longe do farfalhar de páginas na sala de referências. Mas foi já neste século (2002) que o Science Citation Index se desmaterializou em uma base integrada na plataforma conhecida como Web of Science. Coincidentemente, logo surgiu o primeiro ranking global de universidades, o ARWU de Xangai, fortemente baseado no número de publicações e citações. Esse acesso facilitado levou à formação de três grupos de interessados, que se juntaram aos bibliometristas profissionais: os próprios provedores de bases de dados e as ferramentas associadas (sim, outras surgiram), os gestores acadêmicos e de pesquisa e, finalmente, os cientistas, preocupados com as avaliações que os administradores fazem.

São os praticantes da “bibliometria leiga”, tradução livre de “citizen bibliometrics”, expressão usada por Loet Leidesdorff, Paul Wouters e Lutz Bornmann em um artigo recente [II], no qual os autores já no resumo advertem que “indicadores bibliométricos como fator de impacto de revistas, índices h e contagem de citações são artefatos algorítmicos que podem ser usados na avaliação e gestão da pesquisa. Esses artefatos não têm significado em si, mas recebem sentidos nos usos em práticas institucionais.” Os quatro grupos de bibliometristas, profissionais e leigos, são os atores nesses processos e o artigo busca informar sobre “o conjunto de problemas (às vezes, não resolvidos) em bibliometria que pode esclarecer um pouco as tensões entre indicadores simples, mas inválidos, amplamente utilizados (como o índice h [III]) e indicadores mais sofisticados, que não são usados ou não podem sê-lo em avaliações, porque não são transparentes, não podem ser calculados ou são difíceis de interpretar”.

Nesse contexto, um “guia de boas práticas” para o uso de indicadores é desejável e esse guia é o Manifesto de Leiden [IV], consolidado em 2014 em uma conferência nessa cidade holandesa. Paul Wouters, do artigo mencionado acima, é um dos signatários, junto com Ismael Ràfols, que já apareceu em colunas passadas e outros três cientometristas de renome. São no total 10 princípios, elucidados no texto do manifesto. Na coluna passada aludi ao terceiro: “proteger a excelência da pesquisa localmente relevante” (O eucalipto e seus impactos). Não há espaço aqui para discutir todos eles, mas enunciar os dois primeiros deve despertar a curiosidade para acessar o link abaixo: “a avaliação quantitativa deve dar suporte à avaliação qualitativa especializada” e “medir o desempenho de acordo com a missão da instituição, do grupo ou do pesquisador”. De traz para frente, temos o décimo princípio: “examinar e atualizar os indicadores regularmente”. Os autores mencionam que a missão da pesquisa e o objetivo da avaliação se modificam. Eu acrescento outro efeito, baseado na lei de (Donald) Campbell, apresentado a mim por Luiz Carlos de Freitas: “quanto mais um indicador é usado para tomadas de decisões, mais sujeito ele estará a pressões que o corrompem e mais apto ele será para distorcer e corromper o processo que ele busca monitorar”. Não são poucos os relatos que ouvi de colegas, aqui e alhures, sobre como se autocitam para aumentar o tal índice h.

Lendo o artigo de Leydesdorff e colaboradores e os princípios do Manifesto de Leiden, emerge da memória a figura de Frankenstein – o Prometeu moderno –, não do romance original, mas das inúmeras ressignificações cinematográficas: a criatura toma o nome do seu criador e ambos têm um final pouco feliz.

[I] “How to use He science citation índex – part 1”: (as outras partes aparecem naturalmente)

[II] Leydesdorff, L., Wouters, P. e Bornmann, L.: Professional and citizen bibliometrics: complementarities and ambivalences in the development and use of indicators—a state-of-the-art report, Scientometrics (2016) 109:2129–2150.

[III] Para quem não se confrontou ainda com esse número: h é o número de artigos com pelo menos h citações. Como diz Leydesdorff: “ou seja, completamente arbitrário”.

[IV] http://www.sibi.usp.br/iniciativas/bibliometria-e-indicadores-cientificos/manifesto-leiden/